Função custo: Linear e Logística

26 Aug 2019Função custo

Quando traçamos um gráfico relacionando duas variáveis, geralmente não é possível que uma reta passe por todos os pontos. Portanto, nosso objetivo é encontrar a reta que melhor se ajusta aos dados disponíveis.

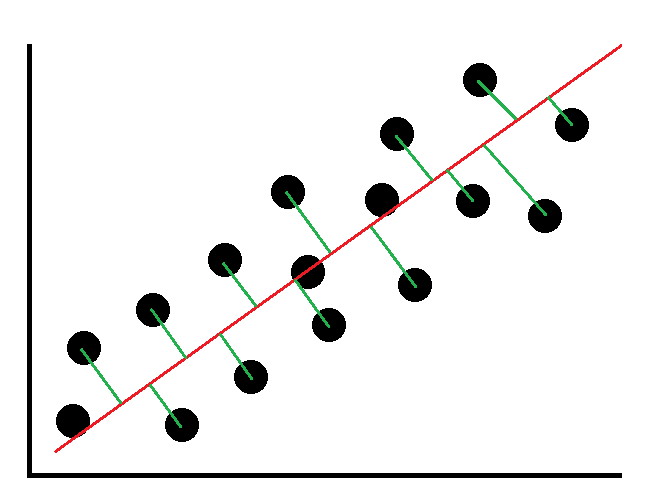

Como ilustrado abaixo, podemos observar a distância entre a reta usada para prever um valor e o ponto real correspondente. Essa diferença entre o valor real e o valor previsto é essencial para calcular uma função de custo.

Mas como saber se essa reta é a melhor escolha? Talvez uma ligeira inclinação para baixo resultaria em previsões mais precisas, ou talvez um leve aumento. É aí que entra o conceito do gradiente descendente.

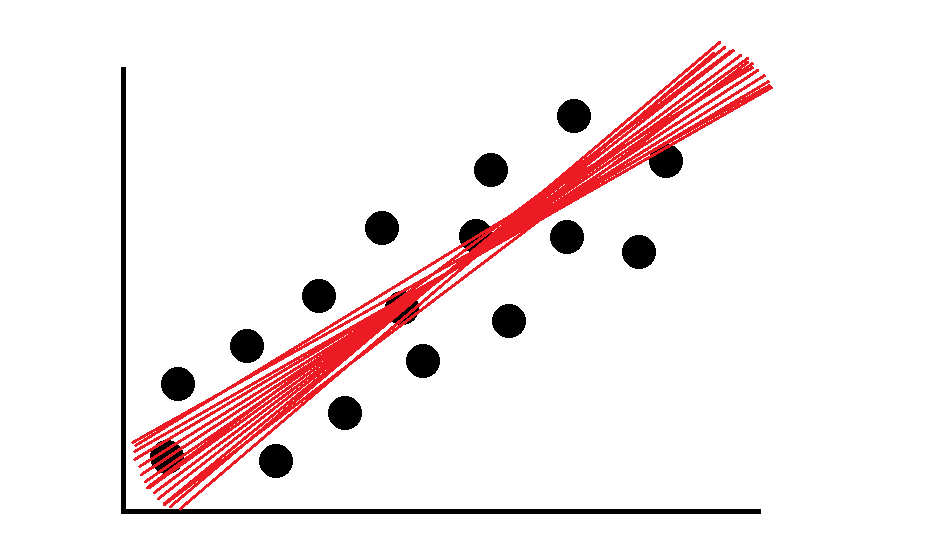

O gradiente descendente representa todas as possíveis retas que poderiam se ajustar ao modelo, uma infinidade delas. Cada uma dessas retas gera um valor de custo, e todos esses valores são usados para criar um novo gráfico.

Exemplo das muitas possibilidades:

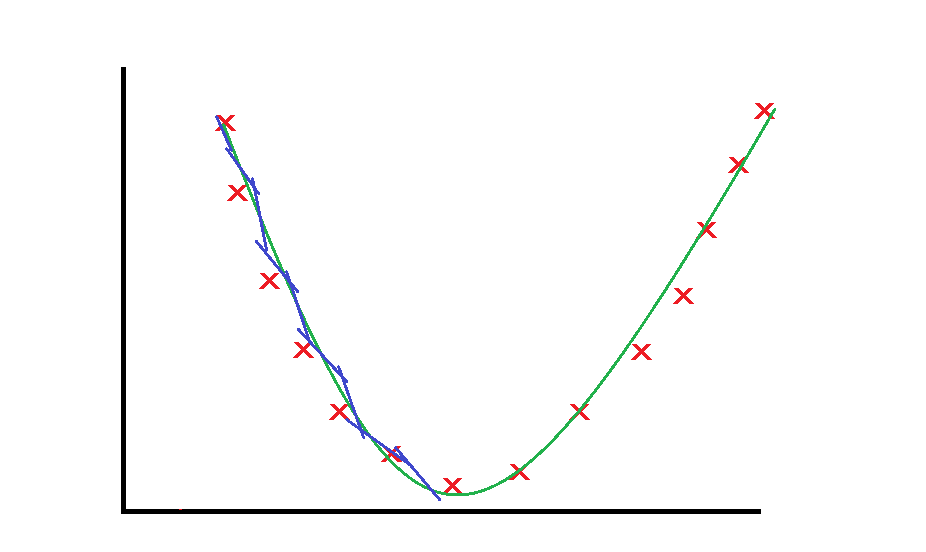

Cada ponto no gráfico resulta da função de custo aplicada a cada reta possível. No ponto mais baixo do gráfico, encontramos a reta que melhor se ajusta ao modelo, representando o mínimo da função de custo. Portanto, usamos o gradiente descendente para encontrar esse ponto.

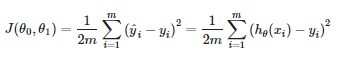

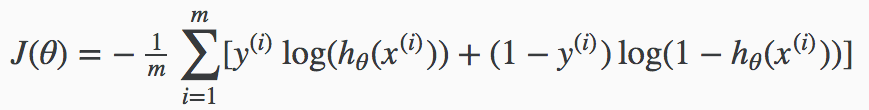

A função de custo é usada tanto em regressão linear quanto em regressão logística, seguindo o mesmo conceito, embora com fórmulas diferentes, como mostrado abaixo:

Função de custo para regressão linear

Função de custo para regressão logística

A diferença entre essas funções ocorre porque, no caso da regressão logística, nossas variáveis de saída são binárias. Se usássemos a função de custo da regressão linear, o gráfico do gradiente descendente seria não convexo, o que resultaria em vários mínimos locais, ocultando o mínimo global desejado.